密歇根大学发明软硬件协同设计 使AI在边缘设备上高效运行

分享

分享

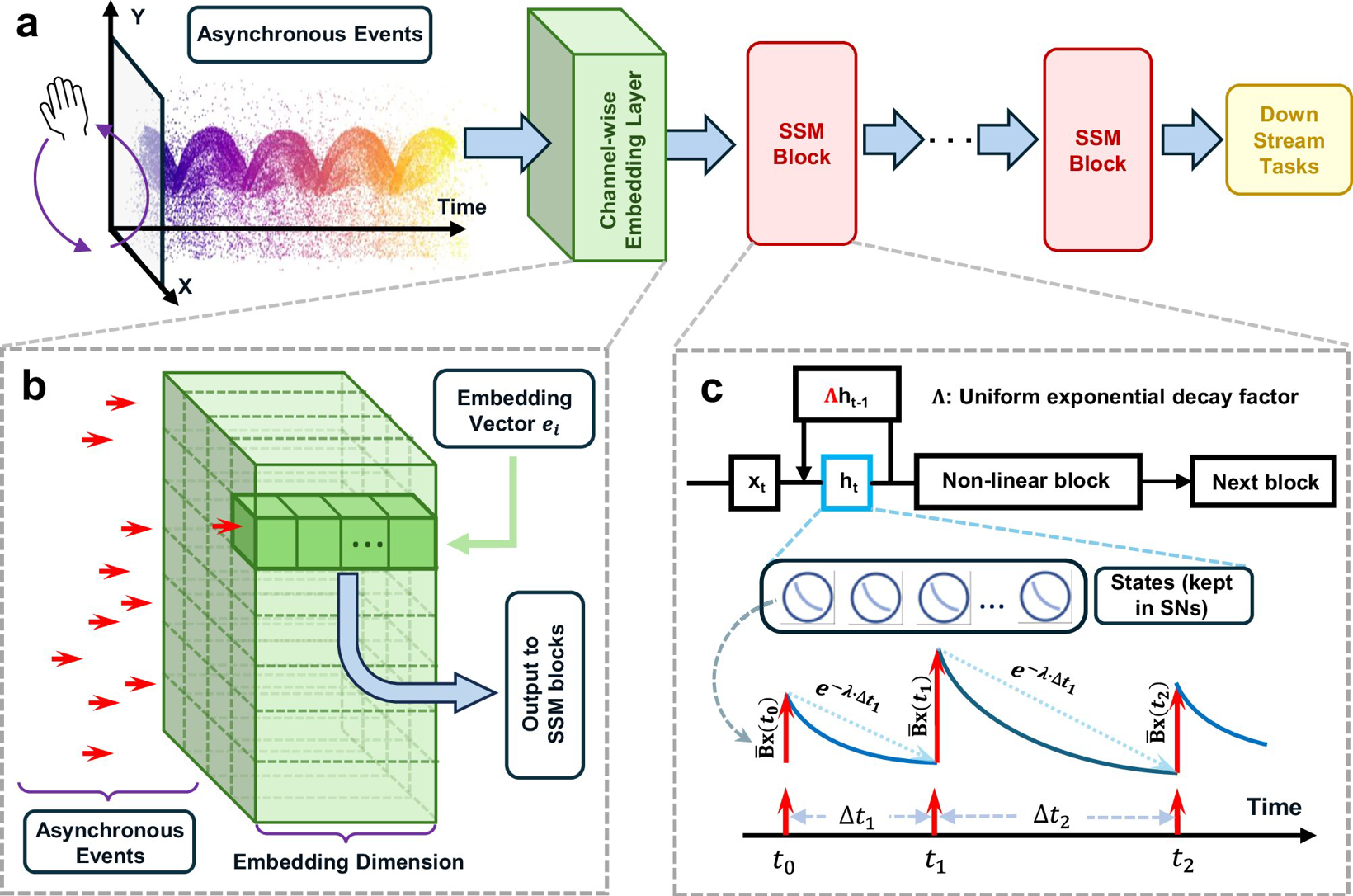

盖世汽车讯 据外媒报道,密歇根大学工程学院(University of Michigan Engineering)的研究人员发明全新的软硬件协同设计方案,提高了人工智能(AI)的能效并降低了延迟,从而能够实时处理视频或传感器数据流等连续数据流。相关研究发表在期刊《Nature Communications》上,研究表明这种神经形态方法使得强大的实时AI可以直接在手机、助听器或自动驾驶汽车摄像头等本地边缘设备上运行。

该研究团队首次将复杂的状态空间模型(一种替代ChatGPT等Transformer模型的尖端技术)直接映射到内存计算架构上。

图片来源:期刊《Nature Communications》

密歇根大学(U-M)James R. Mellor工程学教授、该研究的通讯作者Wei Lu表示:“内存计算系统具有极高的能效和吞吐量,但它们较为僵化,并非卷积神经网络和Transformer网络的最佳选择。在该研究中,我们证明了内存计算系统非常适合状态空间模型。状态空间模型中的所有操作都可以通过内存计算系统中的设备物理特性高效实现,这有望实现这些前景广阔的网络的高效硬件部署。”

AI处理效率问题

在边缘设备(例如智能手机、可穿戴健康监测器或自动驾驶汽车等电池供电设备)上运行AI推理,可以将数据本地化,从而提高速度、隐私性和效率。然而,目前的硬件和软件效率不足以在边缘设备上运行高级AI。

在硬件方面,数据在不同的内存和处理单元之间不断传输,造成了高能耗的瓶颈。内存计算硬件可以通过将数据存储在同一位置并进行处理来避免这个问题,但它与大多数AI模型使用的复杂数学运算不兼容。

在软件方面,像ChatGPT这样的Transformer模型会随着输入或对话长度的增加而占用更多内存,导致一些长序列耗尽内存的情况。像脉冲神经网络这样的模型由于仅在新数据到达时才激活,因此提高了内存效率,但它们的准确性较差。该研究团队通过设计一个软硬件互补的系统,解决了这两个效率问题。

软硬件协同设计方案

以往,高性能状态空间模型使用复数。这导致芯片需要额外工作,因为电路必须分别追踪每次计算的实部和虚部。研究人员通过调整状态空间模型,使其仅使用实数,从而使每个存储单元能够直接表示一条数据,从而提高了效率。

为了确保实时处理且避免内存瓶颈,研究团队没有为每个神经元单独设置衰减率,而是为模型的整个模块设定了一个固定的衰减率。这个衰减率决定了短期记忆,本质上就是系统“遗忘”旧数据、为新信息腾出空间所需的时间。

该状态空间模型在一个采用标准65纳米CMOS工艺制造的电阻式随机存取存储器(Resistive RAM,RRAM)交叉阵列上实现,从而提供了可扩展性。该交叉阵列本质上是一个晶格结构,其连接点处装有忆阻器,可执行向量矩阵乘法,从而实现快速、低功耗的计算。

为了使硬件与状态空间模型的固定衰减率相匹配,研究人员制造了不同厚度的氧化钨(WOx)忆阻器。这些层状结构是通过400°C的氧气气氛中氧化钨电极形成的,氧化时间分别为20秒(形成较薄的氧化层)和80秒(形成较厚的氧化层)。较薄的氧化层使短期记忆衰减更快,而较厚的氧化层则使短期记忆衰减更慢。

U-M电子与计算机工程博士生、该研究的共同第一作者Xiaoyu Zhan表示:“尽管状态空间模型在处理长序列方面展现出巨大的理论潜力,但它们在传统硬件上的部署效率却非常低下。我们的内存计算实现从物理层面重构了状态空间模型的计算方式,使该领域向高效、硬件原生的AI迈出了重要一步,这种AI可以在任何地方运行。”

低延迟、高能效处理

经物理实验和仿真基准测试,该软硬件协同设计能够高效处理连续事件序列。RRAM交叉阵列执行向量矩阵乘法运算,其结果与理想数学输出仅相差4.6位。在衰减测试中,氧化钨忆阻器的行为与预测模型相符,成功满足了状态空间模型的需求。

总体而言,该新设计实现了实时处理能力,在延迟和功耗方面均显著优于传统数字硬件。

U-M电子与计算机工程博士生、该研究的共同第一作者Mingtao Hu表示:“通常情况下,将复杂的算法从理想的软件环境移植到实际的内存计算硬件中会引入噪声并导致性能下降。然而,我们的架构不仅保持了高精度,而且还大幅降低了能耗。这证明状态空间模型和神经形态硬件是天然的完美匹配。”

欢欢@盖世汽车供应链

欢欢@盖世汽车供应链

悠悠@盖世汽车

悠悠@盖世汽车

豆豆@盖世汽车

豆豆@盖世汽车