千叶大学提出新方法 简化三维全息显示图的生成

盖世汽车讯 全息图长期以来一直有望提供身临其境的三维(3D)体验,但生成全息图所面临的挑战限制了其广泛使用。10月18日,利用深度学习的最新发展,日本千叶大学(Chiba University)的研究人员现在提出改变游戏规则的方法,利用神经网络将普通的二维彩色图像转换为3D全息图。该方法可以简化3D全息图的生成,并可以在医疗保健和娱乐等众多领域找到应用。

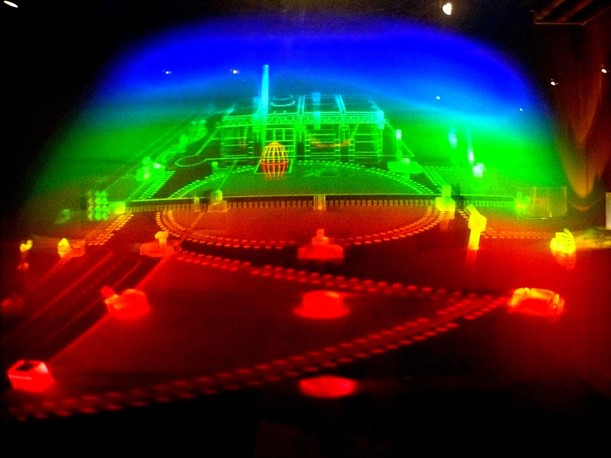

图片来源:千叶大学

提供物体3D视图的全息图可提供常规2D图像无法达到的细节水平。由于能够提供3D对象的真实沉浸式体验,全息图在医学成像、制造和虚拟现实等各个领域具有巨大的应用潜力。传统上,全息图是通过记录物体的三维数据以及光与物体的相互作用来构建的。然而,该技术的计算量非常大,因为它需要使用特殊的摄像头来捕获3D图像,因此全息图的生成具有挑战性并限制了其广泛使用。

近年来,很多研究也提出了许多用于生成全息图的深度学习方法。研究人员可以直接根据使用RGB-D摄像头捕获的3D数据(物体的颜色和深度信息)创建全息图。这种方法规避了与传统方法相关的许多计算挑战,并且代表了一种更简单的生成全息图的方法。

由千叶大学工程研究生院Tomoyoshi Shimobaba教授领导的研究小组提出一种基于深度学习的新颖方法,通过直接从使用普通摄像头捕获的常规2D彩色图像生成3D图像,进一步简化全息图的生成。

Shimobaba教授对这项研究的基本原理进行了解释:“实现全息显示存在几个问题,包括3D数据的获取、全息图的计算成本以及全息图像的转换,以匹配全息显示设备的特性。我们开展这项研究是因为我们相信深度学习近年来发展迅速,有潜力解决这些问题。”

所提出的方法采用三个深度神经网络(DNN),以将常规2D彩色图像转换为可用于将3D场景或对象显示为全息图的数据。第一个DNN使用普通摄像头捕获的彩色图像作为输入,然后预测相关的深度图,提供有关图像3D结构的信息。随后第二个DNN利用原始RGB图像和第一个DNN创建的深度图来生成全息图。最后,第三个DNN细化了第二个DNN生成的全息图,使其适合在不同设备上显示。

研究人员发现,新方法处理数据和生成全息图所需的时间优于最先进的图形处理单元。“新方法的另一个优势是,最终全息图的再现图像可以代表自然的3D再现图像。此外,由于在全息图生成过程中不使用深度信息,因此这种方法成本低廉,并且在训练后不需要RGB-D摄像头等3D成像设备。”Shimobaba教授在进一步讨论结果时补充道。

在不久的将来,这种方法可以应用于汽车抬头显示器和头戴式显示器,以生成高保真3D显示。同样,它可以彻底改变车载全息平视显示器的产生,以3D方式向乘客呈现有关人员、道路和标志的必要信息。因此,新方法有望为增强全息技术的发展铺平道路。

欢欢@盖世汽车供应链

欢欢@盖世汽车供应链

悠悠@盖世汽车

悠悠@盖世汽车

豆豆@盖世汽车

豆豆@盖世汽车